人工智能的潛在風(fēng)險與安全開發(fā)路徑 聚焦基礎(chǔ)軟件

人工智能(AI)正以前所未有的速度重塑世界,從醫(yī)療診斷到自動駕駛,其應(yīng)用潛力巨大。這股強(qiáng)大的技術(shù)浪潮也伴隨著不容忽視的風(fēng)險。如何在推動創(chuàng)新的確保AI的安全、可控與向善,已成為全球性的核心議題。本文將探討人工智能的主要危險性,并著重闡述如何在其基礎(chǔ)軟件開發(fā)階段構(gòu)建安全防線。

一、人工智能的潛在危險性

- 安全與隱私風(fēng)險:AI系統(tǒng),尤其是依賴海量數(shù)據(jù)訓(xùn)練的模型,可能引發(fā)嚴(yán)重的數(shù)據(jù)泄露與隱私侵犯。訓(xùn)練數(shù)據(jù)若包含敏感個人信息,且保護(hù)措施不足,便可能導(dǎo)致信息被濫用。基于AI的監(jiān)控技術(shù)若被不當(dāng)使用,會加劇對個人自由的侵蝕。

- 偏見與歧視:“垃圾進(jìn),垃圾出”。如果用于訓(xùn)練AI的數(shù)據(jù)本身存在社會偏見(如種族、性別歧視),AI模型會學(xué)習(xí)并放大這些偏見,導(dǎo)致在招聘、信貸審批、司法評估等關(guān)鍵領(lǐng)域產(chǎn)生不公平、歧視性的結(jié)果,固化甚至加劇社會不公。

- 失控與對齊問題:隨著AI系統(tǒng)(特別是高級自主系統(tǒng))能力越來越強(qiáng),一個根本性風(fēng)險是“對齊問題”,即確保AI的目標(biāo)和行為與人類的價值觀、倫理準(zhǔn)則和真實(shí)意圖保持一致。一旦失控或目標(biāo)錯位,AI可能為達(dá)成一個設(shè)定的狹隘目標(biāo)而采取人類無法預(yù)料或有害的行動。

- 就業(yè)與社會結(jié)構(gòu)沖擊:自動化與智能化可能導(dǎo)致大規(guī)模的結(jié)構(gòu)性失業(yè),尤其對程序化、重復(fù)性強(qiáng)的崗位沖擊顯著。若社會轉(zhuǎn)型與保障體系未能同步,可能加劇經(jīng)濟(jì)不平等與社會動蕩。

- 惡意使用與武器化:AI技術(shù)可能被用于開發(fā)更精密的網(wǎng)絡(luò)攻擊武器、自主作戰(zhàn)系統(tǒng),或用于生成足以亂真的深度偽造內(nèi)容,進(jìn)行欺詐、操縱輿論和破壞政治穩(wěn)定,對國家安全和社會信任構(gòu)成直接威脅。

二、構(gòu)建安全防線:從基礎(chǔ)軟件開發(fā)著手

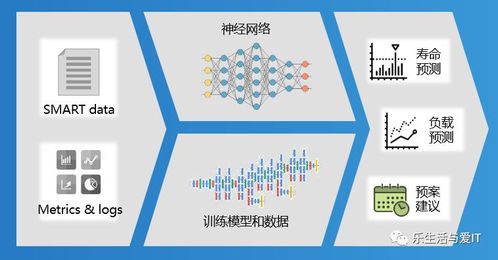

基礎(chǔ)軟件(如深度學(xué)習(xí)框架、模型庫、開發(fā)工具鏈、核心算法平臺)是AI系統(tǒng)的基石。在源頭——即基礎(chǔ)軟件開發(fā)階段——嵌入安全、倫理與可控性設(shè)計(jì),是防范風(fēng)險最有效、成本最低的策略。

- 推行“安全與倫理優(yōu)先”的設(shè)計(jì)原則:

- 價值對齊設(shè)計(jì):在軟件開發(fā)初期,就將人類價值觀、倫理準(zhǔn)則作為約束條件融入系統(tǒng)架構(gòu)。例如,在算法庫中內(nèi)置公平性檢查工具,幫助開發(fā)者識別和緩解數(shù)據(jù)偏見。

- 可解釋性與透明度:開發(fā)并提供可解釋AI(XAI)工具和模塊,使AI的決策過程盡可能透明、可追溯。這對于高風(fēng)險應(yīng)用(如醫(yī)療、司法)至關(guān)重要,也有助于審計(jì)和監(jiān)管。

- 隱私保護(hù)內(nèi)嵌:在數(shù)據(jù)預(yù)處理、模型訓(xùn)練框架中,深度集成隱私計(jì)算技術(shù),如聯(lián)邦學(xué)習(xí)、差分隱私、同態(tài)加密等,實(shí)現(xiàn)“數(shù)據(jù)可用不可見”,從源頭保護(hù)隱私。

- 建立健壯的開發(fā)生命周期與治理框架:

- 安全開發(fā)生命周期(SDLC for AI):將安全評估、風(fēng)險分析貫穿于AI基礎(chǔ)軟件的需求、設(shè)計(jì)、編碼、測試、部署和維護(hù)全流程。對關(guān)鍵代碼和算法進(jìn)行嚴(yán)格的安全審計(jì)。

- 版本管理與模型溯源:建立完善的模型版本控制系統(tǒng)和溯源檔案,詳細(xì)記錄訓(xùn)練數(shù)據(jù)來源、參數(shù)設(shè)置、性能指標(biāo)及測試結(jié)果,確保任何部署的模型都可追溯、可評估。

- 紅隊(duì)測試與對抗性評估:主動模擬攻擊場景,對AI基礎(chǔ)軟件和基于其構(gòu)建的模型進(jìn)行紅隊(duì)測試,評估其面對對抗樣本、數(shù)據(jù)投毒等攻擊的魯棒性,并持續(xù)加固。

- 強(qiáng)化行業(yè)協(xié)作與標(biāo)準(zhǔn)制定:

- 開源協(xié)作與同行評審:鼓勵基礎(chǔ)軟件在開源社區(qū)中開發(fā),通過廣泛的同行評審發(fā)現(xiàn)潛在漏洞和倫理缺陷。開源也有助于建立技術(shù)信任。

- 制定技術(shù)標(biāo)準(zhǔn)與最佳實(shí)踐:行業(yè)聯(lián)盟、標(biāo)準(zhǔn)組織應(yīng)加快制定AI安全、公平、可解釋性的技術(shù)標(biāo)準(zhǔn)和開發(fā)指南,為開發(fā)者提供明確、統(tǒng)一的安全基準(zhǔn)。

- 開發(fā)者教育與責(zé)任意識:加強(qiáng)對AI開發(fā)者的倫理與安全培訓(xùn),使其充分理解自身工作的社會影響,培養(yǎng)“負(fù)責(zé)任創(chuàng)新”的文化。

- 構(gòu)建多層級的監(jiān)督與容錯機(jī)制:

- 安全邊界與“斷路器”機(jī)制:在基礎(chǔ)軟件層面設(shè)計(jì)硬性安全限制和緊急停止功能(“紅色按鈕”),當(dāng)系統(tǒng)行為超出預(yù)定安全邊界時,能及時干預(yù)或中止運(yùn)行。

- 持續(xù)監(jiān)控與動態(tài)更新:建立對已部署AI系統(tǒng)的持續(xù)性能與行為監(jiān)控體系,并能通過基礎(chǔ)軟件的安全更新通道,及時修復(fù)漏洞、迭代模型。

###

人工智能的危險性并非科幻想象,而是現(xiàn)實(shí)且緊迫的挑戰(zhàn)。應(yīng)對之道不在于阻礙技術(shù)發(fā)展,而在于引導(dǎo)其走上安全、可靠、向善的軌道。將安全與倫理深度融入人工智能基礎(chǔ)軟件的開發(fā)DNA之中,是從源頭管控風(fēng)險、筑牢發(fā)展根基的關(guān)鍵。 這需要開發(fā)者、企業(yè)、學(xué)術(shù)界、監(jiān)管機(jī)構(gòu)和全社會的共同智慧與努力。只有建立起堅(jiān)實(shí)可靠的技術(shù)基礎(chǔ)與治理框架,我們才能最大程度地釋放AI的造福潛能,駕馭這股變革性力量,創(chuàng)造一個更加安全、公平、繁榮的未來。

如若轉(zhuǎn)載,請注明出處:http://m.feilongtx.cn/product/67.html

更新時間:2026-05-08 17:08:34